Diez notas sobre la AI Action Summit de París

por Enrique Benítez Palma

Entre el 10 y el 11 de febrero, París ha acogido la celebración de la AI Action Summit, que ha dejado algunos titulares efímeros pero que parece no haber sido analizada con el detenimiento y la atención que merece. Con estas diez notas, desde el Observatorio Sector Público -Inteligencia Artificial (OSPIA) pretendemos aportar una visión amplia y global sobre esta importante cumbre recién concluida en París.

1.- No se trata de una cumbre aislada. Es el tercer evento de este tipo (AI Summit Series), y sucede a las reuniones previas de Londres (2023) y Seúl (2024). La cumbre de Londres (AI Safety Summit) se cerró con la Declaración de Bletchley Park, un espacio simbólico en el que trabajó durante la Segunda Guerra Mundial el equipo de descodificadores de las comunicaciones alemanas liderado por Alan Turing. Esta primera cumbre puso el foco en el concepto de seguridad (safety: esto es importante) entendida como seguridad para la sociedad y los usuarios de la IA. Sus principales resultados fueron la publicación anual del International AI Safety Report y la creación de una red global de instituciones encargadas de velar por el cumplimiento de estas condiciones de seguridad para la sociedad (los AISIs: Artificial Intelligence Safety Institutes). En Seúl, en la cumbre co-organizada por Corea del Sur y el Reino Unido, se amplió el abanico de entidades participantes (sobre todo a empresas líderes) y la declaración se centró en el fomento de la cooperación internacional y el desarrollo de marcos de gobernanza de la IA interoperables entre países (mediante la integración del Código Internacional de Conducta para organizaciones que desarrollan sistemas avanzados de IA nacido del Proceso de Hiroshima, del G7). La agenda de Seúl aboga por el desarrollo de una IA centrada en el ser humano en colaboración con el sector privado, el mundo académico y la sociedad civil.

2.- La apertura de la Cumbre. Una de las grandes novedades de la Cumbre de París ha sido su apertura a la sociedad civil, a las organizaciones no gubernamentales y a las instituciones académicas. Para conocer mejor las expectativas previas es importante leer algunos análisis relevantes. El más completo lo publicó el Center for the Governance of AI el 22 de enero de 2025. Volveremos a este análisis más adelante. El 28 de enero, Max von Thun y Michelle Nie publicaban en Tech Policy Press (The Paris AI Action Summit: A Pivotal Moment to Reclaim AI From Big Tech) un artículo señalando que la Cumbre de París podría ser un “momento crucial para rescatar la IA de las grandes tecnológicas” (las Big Tech). Para estos autores, el verdadero objetivo de la Cumbre debía estar en proporcionar los bienes públicos fundamentales necesarios para alinear la IA con el interés público. Sin embargo, siguen los autores, la cumbre no lograría este objetivo a menos que abordara el problema más acuciante (el elefante en la habitación): el creciente dominio de las grandes empresas tecnológicas sobre el ecosistema de la inteligencia artificial y su progresivo control de la gobernanza de la inteligencia artificial, cada vez más respaldado por el poder del Gobierno de Estados Unidos. Aquí hay que señalar varias cuestiones: la idea de la alineación de la IA/ML con los valores humanos (la referencia es el libro de Brian Christian, The Alignment Problem); el concepto de Interés Público (Public Interest), muy presente en las expectativas de la sociedad civil y los ámbitos académicos; y finalmente el creciente poder e influencia de las grandes empresas en el diseño de la gobernanza global de la IA, gracias en parte a la puerta que se abrió tras el impulso de la ONU al concepto de “multistakeholderism”, criticado con razón ya en 2019 por organizaciones independientes como el Transnational Institute. Sobre este desequilibrio de poder e intereses también se publicó el 7 de febrero en Tech Policy Press un vibrante análisis firmado por William Burns (The Paris AI Action Summit: The Eighteenth Brumaire of Big Tech?), que señala las buenas intenciones de la Cumbre de París al incorporar las visiones más críticas, pero concluye anticipando que “dada la trayectoria de las cosas, es probable que las grandes empresas tecnológicas salgan de la niebla del diálogo de París con más poder que antes, ya que las naciones parecen más interesadas en explotar la IA que en regularla o contener sus efectos sobre las personas y las sociedades”. Una previsión muy certera.

Siguiendo con los análisis previos, hay un par de aportaciones que merece la pena destacar. La primera es la del Ada Lovelace Institute (A piece of the action, firmada por Catherine Gregory y Michael Birtwistle), que propone 4 preguntas que deberían ser respondidas en la Cumbre: ¿Cuál será la reacción ante el creciente desequilibrio de poder en el ecosistema de la IA? ¿Se impulsará el interés público? ¿Recibirá la Agentic AI la atención -y las soluciones de gobernanza- que merece? ¿Tendrán los desarrolladores que seguir ‘marcándose los deberes’ en lo que respecta a los riesgos de la IA? La segunda aportación a destacar la firma Fei Fei Li, pionera de la IA, en el Financial Times del 8 de febrero, y se basa en la propuesta de tres principios fundamentales para el futuro de la política de la IA (policymaking of AI): Usar la ciencia, no la ciencia-ficción; ser pragmáticos, más que ideológicos (aquí defiende la necesidad de minimizar las consecuencias no deseadas de la IA sin desincentivar la innovación); y empoderar al ecosistema de IA, incluyendo las comunidades de código abierto (open source) y el mundo académico. Ella misma forma parte ahora del HAI (Human-centered AI) de la Universidad de Stanford.

3.- Las condiciones para el éxito de la Cumbre de París. Volvemos al extraordinario documento del Centre for the Governance of AI (What Success Looks Like for the French AI Action Summit), publicado el 22 de enero. Para sus autores, la Cumbre debía finalizar al menos con tres resultados: garantizar el futuro de estas Cumbres (AI Summit Series); asegurar la participación de altos cargos de los Estados Unidos y China; y demostrar que se sigue avanzando en los compromisos clave de seguridad (safety). Respecto al primer punto, apuntan que esta serie de Cumbres necesita estructuras más claras, con una cadencia o periodicidad preestablecida (mejor dos veces al año, dada la rapidez del avance tecnológico), un ámbito y un programa concretos y un proceso más transparente para designar a los futuros anfitriones. En relación con el segundo punto, destacan que la AI Summit Series son el único foro sobre IA en el que han participado tanto Estados Unidos como China desde sus inicios (Londres y Seúl) y que su éxito depende de la participación continuada de las principales potencias mundiales en IA. En París, sostienen, será importante reafirmar los compromisos de ambas naciones, sobre todo teniendo en cuenta la ausencia de China en la Declaración de Seúl y el cambio de prioridades de la próxima administración estadounidense. Finalmente, respecto al avance en los compromisos clave, defienden que es especialmente necesario actualizar los progresos de tres iniciativas fundamentales: los marcos de seguridad de la Frontier AI; el informe internacional sobre la seguridad de la IA (International AI Safety Report) y la red de AISIs (AI Safety Institutes). Todos estos puntos son bien expuestos, argumentados y desarrollados en un análisis de lectura imprescindible, que permite -con la Cumbre ya celebrada- tener la perspectiva y la información suficientes como para poder valorar con rigor si ha sido un éxito o un fracaso.

4.- La Cumbre y su declaración (statement) final. La Cumbre francesa de 2025 ha sido la más grande hasta la fecha y marca un cambio en dos sentidos. En primer lugar, la ampliación del alcance, ya que hay cinco temas en la agenda: IA de interés público, futuro del trabajo, innovación y cultura, confianza en la IA, y gobernanza global de la IA. Además, a los dos días oficiales de Cumbre hay que añadir dos "Días de la Ciencia", un "Fin de Semana Cultural" y docenas de actos paralelos copatrocinados sobre una amplia gama de temas a lo largo de la semana. En segundo lugar, ha sido la Cumbre de mayor asistencia: 90 países han sido invitados, incluyendo cerca de 1.000 jefes de Estado y de Gobierno, CEOs, líderes de grupos de reflexión, organizaciones de la sociedad civil, institutos de investigación y artistas.

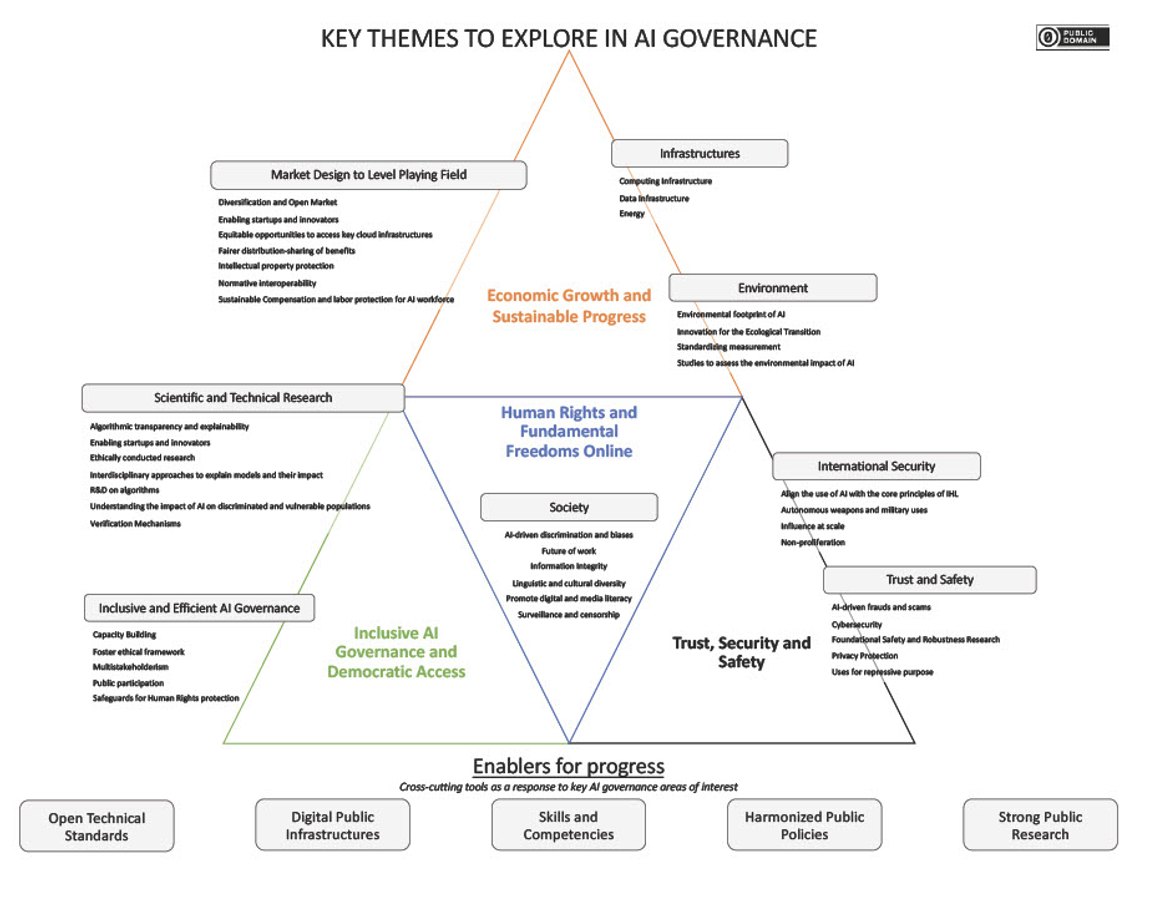

Se ha compartido este notable gráfico sobre los asuntos a debatir:

Y con respecto a la Declaración final (Declaración sobre Inteligencia Artificial inclusiva y sostenible para las personas y el planeta), la noticia fue que no la firmaron o suscribieron ni Estados Unidos ni el Reino Unido, aunque sí lo hicieron 61 países, destacando China. El texto revela cuáles son las siguientes prioridades principales a partir de este momento:

· Promover la accesibilidad de la IA para reducir las brechas digitales.

· Garantizar que la IA sea abierta, inclusiva, transparente, ética, segura y digna de confianza, teniendo en cuenta los marcos internacionales para todos.

· Hacer que prospere la innovación en IA facilitando las condiciones para su desarrollo y evitando la concentración del mercado impulsando la recuperación y el desarrollo industriales.

· Fomentar un despliegue de la IA que modele positivamente el futuro del trabajo y los mercados laborales y ofrezca oportunidades de crecimiento sostenible.

· Hacer que la IA sea sostenible para las personas y el planeta.

· Reforzar la cooperación internacional para promover la coordinación en la gobernanza internacional.

Con estos datos sobre la mesa, y a la vista de lo ocurrido, ya es posible hacer un análisis sobre el éxito o fracaso de la Cumbre.

5.- El papel de la Unión Europea. El 11 de febrero, la presidenta Von der Leyen intervino por segunda vez en la Cumbre para realizar los anuncios referentes a la UE. En primer lugar, defendió la perspectiva europea, insistiendo en tres aspectos característicos: el uso de la IA en aplicaciones complejas, el componente cooperativo de la IA europea, y la apuesta por el código abierto, que “puede extenderse más rápido que los sistemas propietarios”. Conviene recordar aquí el lanzamiento de DeepSeek en enero, poco tiempo antes. Y con respecto a los planes de acción europeos, destacó dos: la aceleración de la innovación (recordando la inversión en marcha de 10.000 millones de euros en las 12 factorías de IA ya existentes, una de ellas en Barcelona, para elevarlas a Gigafactorías, siguiendo el exitoso modelo del CERN de Ginebra, y la dotación de un marco de referencia único para el conjunto de la UE), y la movilización de capital para la inversión, hasta 200.000 millones de euros a través de la European AI Champions Initiative. Estos anuncios coparon la mayoría de los titulares de prensa.

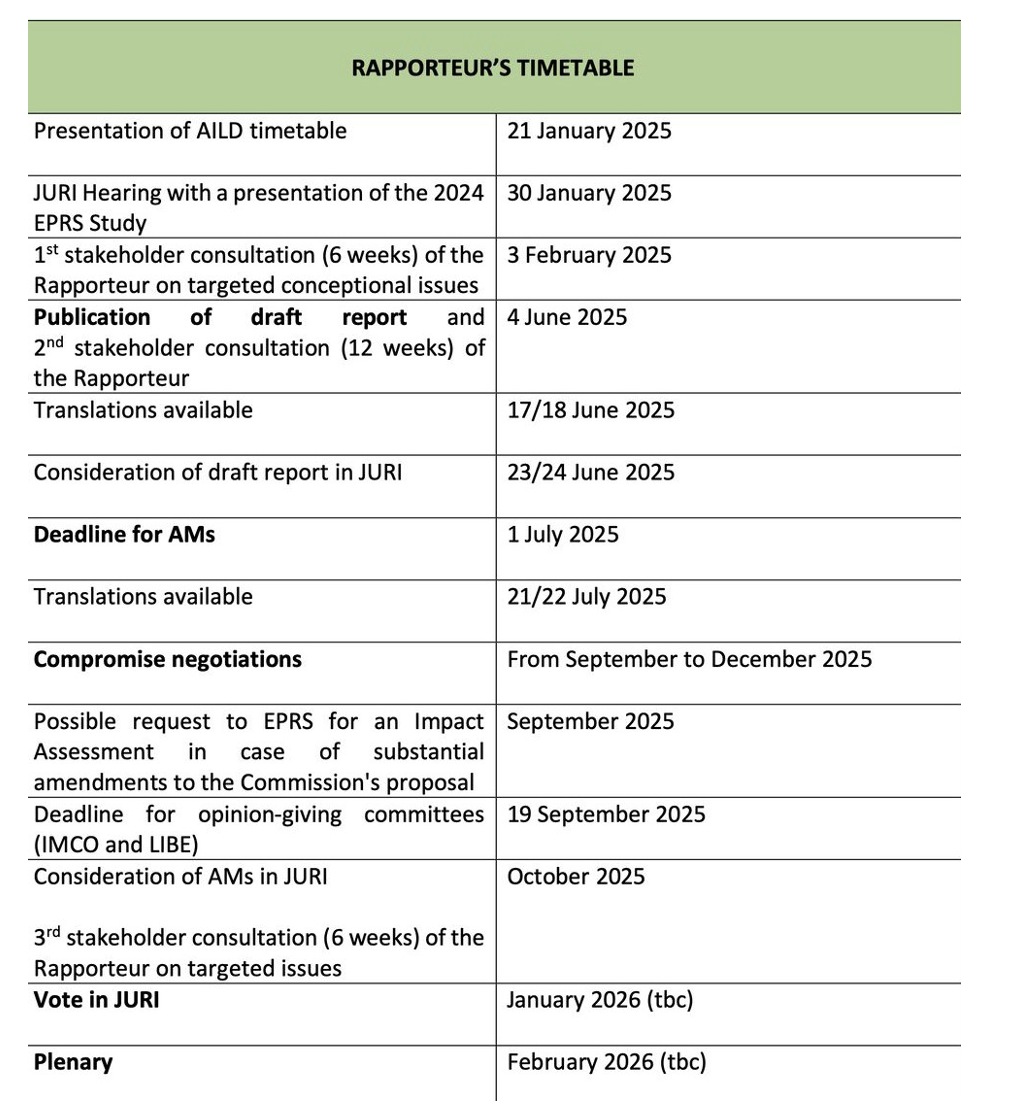

Sin embargo, también se anunció la retirada de la prevista Directiva sobre la responsabilidad de la IA (AI Liability Directive: AILD), cuyo calendario (timeline) se había anunciado apenas unas semanas antes de su descarte:

El anuncio del descarte, hecho el mismo día que el presidente Macron clausuraba la Cumbre de París, supuso un enorme jarro de agua fría para quienes creían en la necesidad de contar con un marco normativo específico para defender a los consumidores y los ciudadanos de los posibles daños causados por la IA, abriendo la puerta a la reclamación de indemnizaciones. Uno de sus principales impulsores, el eurodiputado alemán Axel Voss, llegó a publicar en LinkedIn (después lo borró) que “la Comisión está eligiendo activamente la inseguridad jurídica, los desequilibrios de poder corporativo y un enfoque del salvaje oeste sobre la responsabilidad de la IA que sólo beneficia a las Big Tech”. Para profundizar en los motivos y consecuencias de este inesperado anuncio, sería preciso analizar el draft conocido de la AILD (Proposal COM(2022) 496, de 28 de septiembre), el interesante policy brief del Centrum für Europäische Politik (www.cep.eu) sobre este tema y el paper de 2023 de Philipp Hacker, de la European New School of Digital Studies, titulado The European AI liability directives – Critique of a half-hearted approach and lessons for the future.

Sea como sea, y sin profundizar más en la AILD, sí que es conveniente recoger aquí el brillante análisis de Hannah Ruschmeier de 18 de febrero (The De-Regulatory Turn of the EU Commission), publicado en Verfassungblog.de: el anuncio de una movilización europea millonaria puede estar bien, pero los ciudadanos sólo se beneficiarán de las grandes promesas relacionadas con la IA si también se abordan y compensan los daños que pueda causar. Lo visto en la Cumbre de París sugiere un lavado de cara europeo ante la decisión real de seguir el ejemplo de Estados Unidos, afirma Ruschmeier, para la que un "enfoque europeo" basado en el Estado de Derecho y centrado en el ser humano tiene mucho que ofrecer. Para la autora, este enfoque puede incluso constituir el "mejor modelo de negocio" en términos de lógica de mercado estadounidense. En última instancia, además, la tan denostada burocracia debe contemplarse desde un ángulo diferente: como un mecanismo de seguridad. Al fin y al cabo, “la burocracia es un sistema de orden y una estructura impersonal de cargos. Establece responsabilidades y procedimientos, aspectos que parecen más importantes que nunca en el mundo actual”. En el falso dilema entre regulación e innovación (imprescindible consultar aquí el paper de Anu Bradford de título casi homónimo), los defensores de la idea de que la regulación perjudica o mata la innovación parecen haber salido victoriosos de París. Tal y como defendía en LinkedIn mi compañera de OSPIA, Luana Lo Piccolo (Global AI Governance & Legal Strategist), “la gobernanza de la IA no es sólo una cuestión de regulación. Se trata de garantizar que nadie se quede atrás en este cambio tecnológico. Se trata de garantizar que la IA no sea propiedad de unos pocos, sino que esté diseñada para todos”.

6.- El papel del Reino Unido. El protagonismo del Reino Unido ha tenido que ver con dos decisiones tan inesperadas como polémicas. Por un lado, no ha firmado o rubricado la declaración final. Por otro lado, se ha hecho público el sutil pero no inocente cambio de nombre de su institución pionera y referente mundial: el Artificial Intelligence Safety Institute es ahora el Artificial Intelligence Security Institute.

Con respecto a la decisión de no firmar, una fuente oficial dijo que “la declaración no ofrece suficiente claridad práctica sobre la gobernanza mundial, ni aborda suficientemente cuestiones más difíciles en torno a la seguridad nacional y el reto que la IA supone para ella”. Más allá de estas palabras, es necesario tener a la vista los planes británicos de convertirse en un país de referencia en el desarrollo y uso de aplicaciones basadas en la IA, sea en la educación, el sector sanitario o la administración pública. Reino Unido lleva años integrando la IA en sus planes estratégicos, diseñando y publicando guías que suelen servir de referencia para otros países y administraciones del mundo, ya que conjuga una mentalidad anglosajona y una cierta pertenencia cultural a la esfera europea con vínculos en Asia e influencia global. Por lo tanto, la decisión de no firmar hay que relacionarla con la presentación el 13 de enero del AI Opportunities Action Plan y la publicación el 10 de febrero del AI Playbook for the UK Government. Dos iniciativas de calado que apuestan por la IA como oportunidad -y no como amenaza, que sería el enfoque de quienes destacan por encima de todo los posibles riesgos- y cuyo anuncio se ha producido poco tiempo antes de la Cumbre de París.

Más enjundia tiene el cambio de denominación del actual AI Security Institute. Una precisa entrada firmada el 12 de febrero por la investigadora Chinasa T. Okolo para Brookings recuerda que “el concepto de seguridad de la inteligencia artificial (Safety AI) agrupa la investigación, las estrategias y las políticas (policies) destinadas a garantizar que estos sistemas sean fiables, estén en consonancia con los valores humanos y no causen daños graves. Aunque este campo aborda tradicionalmente tanto los riesgos inmediatos (por ejemplo, el sesgo algorítmico y la fiabilidad del sistema) como los riesgos a más largo plazo, como las cuestiones de alineación de la IA y las amenazas existenciales para la humanidad, el discurso dominante refleja un marco epistemológico marcadamente occidental”. Hay dos ideas importantes subyacentes: la necesidad de incorporar la visión del llamado Sur Global (Global South), y la diferenciación existente entre el concepto de Safety (preocupación por las consecuencias) y el de Security (que pone el foco en le protección frente a amenazas externas). En este sentido, es recomendable la lectura del análisis del Center for Strategic & International Studies de octubre de 2024 dedicado a la red internacional de AISIs (AI Safety Institutes), firmado por Gregory Allen y Georgia Adamson. Y, por supuesto, el informe del Institute for AI Policy and Strategy (IAPS) de octubre de 2024 dedicado a la primera ola de estas instituciones (Understanding the First Wave of AI Safety Institutes).

Estos documentos, de imposible resumen, nos permiten conocer las funciones de la red, su importancia en el establecimiento de estándares y tener una panorámica internacional actualizada. Existen estas instituciones (por orden de creación) en Reino Unido, Estados Unidos, Japón, Singapur, Unión Europea, Canadá y Corea del Sur, con Francia, Kenia y Australia en proceso de creación. Si atendemos a su misión, destacan la investigación (avanzar en la investigación sobre los riesgos y las capacidades de los sistemas avanzados de IA, así como compartir los resultados más relevantes), el testeo (trabajar en la creación de mejores prácticas comunes para probar sistemas avanzados de IA), la orientación (facilitar enfoques compartidos, como la interpretación de pruebas de sistemas avanzados, cuando proceda) y la inclusión (implicar activamente a países, socios y partes interesadas de todas las regiones del mundo y de todos los niveles de desarrollo, compartiendo información y herramientas técnicas de forma accesible y colaborativa, cuando proceda). Tras el giro del Reino Unido, está por ver qué pasará con la agencia estadounidense, imbricada dentro de la estructura del National Institute of Standards and Technology (NIST), cuya plantilla de 3.400 profesionales ya ha recibido un primer aviso de 500 despidos, dentro de los planes del Department of Governmental Efficiency (DOGE) que dirige Elon Musk.

7.- Los Estados Unidos y la Cumbre de París. La Cumbre de París ha sido el escenario de la primera intervención del nuevo vicepresidente, JD Vance, en un foro internacional. El titular de la revista TIME era explícito: “la seguridad (safety) pasa a un segundo plano en la Cumbre sobre Inteligencia Artificial de París, mientras Estados Unidos aboga por una menor regulación”. Una de las citas textuales del discurso de JD Vance dice lo siguiente: “no estoy aquí esta mañana para hablar de la seguridad de la IA (Safety AI), que era el título de la conferencia de hace un par de años. Estoy aquí para hablar de la oportunidad de la IA”. Un entrecomillado que ayuda a explicar la decisión británica, con la perspectiva del mencionado plan presentado a mediados de enero. La postura de Vance no deja lugar a dudas: “restringir ahora el desarrollo [de la IA] no sólo beneficiaría injustamente a los operadores tradicionales del sector, sino que supondría paralizar una de las tecnologías más prometedoras que hemos visto en generaciones". Una declaración que hay que relacionar con el apoyo de las Big Tech al nuevo presidente estadounidense, con el deseo de explorar sin límites ni cortapisas hasta dónde nos puede llevar esta tecnología, pero también con la propuesta de Fei Fei Li (creer a la ciencia, no a la ciencia ficción), la amenaza para el modelo de negocio de la IA basado en suscripciones globales que amenaza Deep Seek, y por supuesto el tablero geopolítico que promete dar una posición de dominio global a quienes dispongan de la suficiente soberanía tecnológica dentro de sus fronteras. Una partida de ajedrez en toda regla.

Kevin Rose escribió para el New York Times el 10 de febrero que en la Cumbre de París se ha dejado de lado a los pesimistas en favor de una visión más optimista del potencial de la tecnología, y que se invitó a panelistas y ponentes a hablar de la capacidad de la inteligencia artificial para acelerar el progreso en áreas como la medicina y la climatología, mientras que las conversaciones más pesimistas sobre los riesgos de la inteligencia artificial quedaron relegadas a eventos paralelos no oficiales. Asimismo, el Wall Street Journal publicó una columna de opinión muy alineada con la advertencia de Vance sobre la amenaza que supone la regulación para la innovación. Poco queda, entonces, del espíritu original de estas cumbres, cuya primera edición, la de Londres, se llamó precisamente London AI Safety Summit. En sólo dos años, el panorama ha cambiado radicalmente.

Desde el lado europeo, el reconocido experto Cristophe Carugati publicó el 20 de febrero un breve artículo de opinión alarmante, señalando con cierto pesar que la “guerra relámpago” de Estados Unidos obliga a Europa a negociar sus normas tecnológicas, y que el acuerdo marcará el futuro de la gobernanza tecnológica mundial.

8.- La cuestión del interés público. En el ámbito de la IA, el interés público (public interest) significa que el desarrollo y el uso de sistemas de IA no se deben centrar principalmente en la maximización del beneficio o en intereses privados, sino en beneficiar a la sociedad en su conjunto. En este sentido, se pueden consultar algunos de sus postulados y planteamientos en la web (publicinterest.ai): “el interés público está estrechamente ligado a la idea de democracia y Estado de Derecho. La elaboración de una idea colectiva del interés público en relación con una determinada cuestión es un proceso establecido en muchas sociedades y tiene una larga tradición en el discurso jurídico. El interés público nunca es universal, sino que debe definirse para cada cuestión social mediante un proceso deliberativo y participativo. Para actuar en pro del interés público, los ciudadanos piensan en algo más que en sus intereses privados: piensan y actúan por un bien común”. En el último trimestre de 2024, la revista digital Internet Policy Review dedicó un monográfico a los sistemas de IA para el interés público, coordinado desde el alemán Alexander von Humboldt Institute for Internet and Society. En este monográfico se puede leer que, dado que el interés público necesita la negociación de los ciudadanos no como personas privadas sino como parte de un público colectivo, intercambiando opiniones y experiencias para determinar de manera colaborativa qué soluciones sirven mejor al público, a la sociedad, el proceso de desarrollo de la IA necesita partir de los problemas reales, permitir la disputa (contest) y mejorar el desarrollo mediante un planteamiento integrador que trate de atender las necesidades de los afectados.

Sobre la Cumbre de París y su orientación (o no) hacia el interés público, es necesario mencionar, por supuesto, el anuncio de creación de la iniciativa Current AI, que trabajará para ampliar el acceso a conjuntos de datos públicos y privados de alta calidad, invertir en herramientas e infraestructuras de código abierto para que la IA sea más transparente y segura, y desarrollar sistemas para medir el impacto social y medioambiental de la IA. De la mano del Gobierno de Francia, destacadas empresas (como Salesforce), organizaciones filantrópicas y diversos países, cuenta con una inversión inicial de 400 millones de dólares y pretende movilizar en esta misión hasta 2.500 millones en los próximos 5 años.

Sobre este mismo asunto, el interés público, ha escrito su propia experiencia la científica Abeba Birhane, fundadora del Artificial Intelligence Accountability Lab (AIAL). Uno de sus primeros párrafos centra muy bien el terreno de juego: “una de las concepciones más comunes -y de las que más se peca en este ámbito- es la falsa dicotomía que presenta la IA únicamente en términos de ‘oportunidades y riesgos’. Esta doctrina considera que el mundo se compone únicamente de los que construyen la IA y, por tanto, ‘desbloquean oportunidades’, frente a los que descubren y mitigan riesgos y ‘frenan el progreso. Mientras que la ‘innovación’, el ‘avance’ y las ganancias ‘económicas’ encajan perfectamente en la primera categoría, todo lo que exija responsabilidad, rendición de cuentas y pensamiento crítico tiende a ser marginado por quedar fuera del ámbito de las ‘oportunidades’, la ‘innovación’ y el ‘avance’. Esto se basa en la suposición profundamente errónea de que las tecnologías de IA son intrínsecamente buenas y que su adopción masiva conduce inevitablemente a beneficios públicos. En realidad, nada de esto es cierto”. Birhane propone en su texto una batería de medidas para focalizar correctamente el (falso) dilema entre innovación y rendición de cuentas, mejorar la rendición de cuentas (accountability) y la transparencia, y diseñar medidas de “contrapoder” y herramientas de “resistencia”.

9.- La sociedad civil: “oportunidad perdida” es la expresión que más se repite. Las reacciones al desarrollo de la Cumbre y a la ausencia del Reino Unido y de Estados Unidos de la declaración final han sido, mayoritariamente, negativas. Sandra Wachter, catedrática de Tecnología y Regulación del Oxford Internet Institute, afirmó que la retórica que sostiene que la regulación ahogará la innovación es engañosa. "La regulación trata de hacer que la IA sea menos sesgada, más explicable y menos perjudicial", afirma, "¿quién gana realmente cuando no hay regulación? ¿Cómo mejora tu vida si una IA sexista decide que tu hija no puede ir a la universidad? ¿Cómo mejora tu vida si una IA opaca te despide y ni siquiera recibes una explicación? ¿Cómo mejoraría tu vida si se permitiera a la IA difundir información errónea en Internet? ¿Cómo mejoraría su vida si utilizáramos IA insegura y no probada en la atención sanitaria?”. Sin salir de la Universidad de Oxford, los expertos del Oxford Institute for Ethics in AI (John Tasioulas, Ignacio Cofone) señalan el triunfo de los postulados defendidos por la nueva administración Trump en relación con la regulación, la moderación de contenidos o las políticas antitrust. Una oportunidad perdida, dicen.

En esos mismos términos se han expresado Angela Müller y Matthias Spielkamp, de Algorithm Watch, con sede en Berlín. “La pregunta es: ¿qué tipo de IA queremos? ¿Cómo nos aseguramos de que la humanidad no deposita todas sus esperanzas (y su dinero) en modelos de IA cada vez más grandes que consumen cantidades ingentes de agua y energía, son entrenados por personas que trabajan en condiciones precarias y, en última instancia, sólo benefician a un puñado de directores ejecutivos e inversores de enormes empresas?”. Más moderada es la opinión de Nicolas Guernion, del Alan Turing Institute, que destaca en su posicionamiento el apoyo financiero a la IA anunciado por la UE y, sobre todo, el valor que ofrecen las soluciones de código abierto para reducir las desigualdades, no sólo en el llamado Sur Global.

Desde el AI Now Institute, otra institución de referencia, con sede en Nueva York, Amba Kak y Sarah Myers West, participantes en la Cumbre, son muy críticos: “la Cumbre pretendía interrumpir la ola de promoción (boosterism) de la IA que ha configurado el mercado en los últimos años, impulsando una visión de interés público para esta tecnología. Pero la falsa urgencia de la ‘carrera armamentística mundial’ de la IA está a punto de eclipsar esta visión, descentrando lo público en favor de los estrechos intereses de la industria”. No menos contundente se ha mostrado Temi L. de la entidad benéfica británica Glitch, que ha opinado en su cuenta de LinkedIn que “la sociedad civil no está preparada ni cuenta con los recursos necesarios para luchar contra la marea de inversiones gubernamentales y del sector privado en la IA. La Cumbre fue una conferencia de negocios para posicionar a Francia como competidor en la inventada carrera de IA entre EE.UU. y China; parecía que aquellos de nosotros que fuimos convenientemente seleccionados para asistir estábamos allí como parte del escaparate de la llamada inclusión”.

Continuando con las críticas, Damini Satija, director del programa de tecnología y derechos humanos de Amnistía Internacional, ha denunciado que “la falta de apoyo por parte de los organizadores de la Cumbre a los defensores de los derechos humanos y a los representantes de las comunidades que necesitan visados para entrar en Francia es un ejemplo de la falta de un verdadero compromiso para entablar un diálogo en pie de igualdad con la sociedad civil. Si los Estados se toman en serio la adopción de un enfoque abierto, inclusivo y con participación de las múltiples partes interesadas en torno al desarrollo, el despliegue y la regulación de las tecnologías de IA, deben elevar y centrar las voces y las prioridades de las comunidades afectadas".

Finalmente, dos menciones desde Canadá. La contribución de Ana Brandusescu y Renée Siebers para el Montreal AI Ethics Institute, titulada “Deregulation, Fear, Surveillance, que apunta hacia la mina de oro que supone para las empresas de sistemas tecnológicos de vigilancia de fronteras el giro de la Safety AI hacia la Security AI, especialmente en el caso de la frontera entre Canadá y los Estados Unidos, la más larga del mundo. Sin dejar de mencionar que las normas “blandas” (códigos de conducta, códigos éticos, acuerdos voluntarios) son insuficientes para protegernos de las compañías no sometidas a ningún tipo de rendición de cuentas. Por su parte, y sin salir de Canadá, el Center for International Governance Innovation (CIGI) publicó el 12 de febrero un policy brief de Sabhanaz Rashid Diya sobre la aplicación de los principios internacionales de derechos humanos para la gobernanza de la IA. Y este documento trae una advertencia interesante: “a pesar de la importancia que está adquiriendo, el marco de equidad, rendición de cuentas, transparencia y ética (FATE: Fairness, Accountability, Transparency and Ethics) en la gobernanza de la inteligencia artificial (IA) presenta importantes limitaciones. Su definición es inadecuada para hacer frente a las complejidades de un mundo pluralista, carece de consenso sobre los valores normativos que lo sustentan, es propenso al mal uso y a la tergiversación, y promueve inadvertidamente el blanqueamiento ético (ethics washing). Es decir, que la regulación siempre será mejor y más efectiva que la simple declaración de voluntad.

10.- Algunas conclusiones, luces y sombras. Aunque las sombras han sido ya muy remarcadas, con la decepción de la sociedad civil, las ausencias de Estados Unidos y el Reino Unido de la declaración final y la aparente victoria de los intereses defendidos por las Big Tech, algunos analistas y diversas iniciativas prefieren ver la parte positiva. La continuidad de la Cumbre parece garantizada por ser la India país coorganizador en París. Gaia Marcus, del Ada Lovelace Institute, destaca que la Cumbre sí ha ofrecido algunas alternativas para el futuro, sobre todo en cuanto a la sostenibilidad a través de la Coalición por una IA Sostenible (sustainableaicoalition.org), liderada por Francia, la Unión Internacional de Telecomunicaciones y el Programa de Naciones Unidas para el Medio Ambiente. También desde CIGI se apunta, por ejemplo, que Canadá puede desempeñar un papel de liderazgo fundamental en la gobernanza internacional de la IA a través del Pacto Mundial Digital (el Global Digital Compact auspiciado por Naciones Unidas, cuya copresidenta es Carme Artigas, ex secretaria de estado de IA), estableciendo marcos de derechos humanos como norma de gobernanza para los sistemas de IA. Está por ver, pues, el papel que desea jugar Naciones Unidas en el diseño de la gobernanza global de la IA, considerando su trayectoria de los últimos años: la iniciativa del Global Digital Compact (adoptada en septiembre de 2024 en la Cumbre del Futuro celebrada en Nueva York), la publicación en ese momento del informe Governing AI for Humanity, y la puesta en marcha desde enero de 2025 de la ODET (Office for Digital and Emerging Technologies).

Pero quizás lo más relevante de la Cumbre, pese a todo, haya sido el esfuerzo sincronizado de la sociedad civil. En la web de Renaissance Numérique se puede consultar el resultado de los trabajos llevados a cabo para el evento paralelo Global AI Governance: Empowering Civil Society: la consulta ciudadana ha contado con casi 12.000 participantes, 575 propuestas y más de 120.000 votos, mientras que han sido requeridos más de 200 expertos de la sociedad civil y el mundo académico, de cinco continentes, que han definido 15 resultados clave que se podían esperar de la Cumbre. Un trabajo formidable y descomunal, coordinado por Sciences Po, the AI & Society Institute, The Future Society, CNNum y Make.org, que “demuestra el fuerte apoyo público a una regulación sólida de la IA y a un enfoque vigilante del desarrollo de la IA, haciendo hincapié en la necesidad de una gobernanza inclusiva y multilateral”. Un trabajo desconocido e ignorado que concede más fuerza aún al llamamiento escrito por Jonathan van Geuns para Tech Policy Press el 19 de febrero (Beyond the Façade: Challenging and Evaluating the Meaning of Participation in AI Governance): hablar de gobernanza de la IA supone hablar de su captura corporativa. “Las empresas tecnológicas actúan como legisladores privados, diseñando los marcos éticos que rigen su propia conducta. Hablan de apertura mientras acaparan algoritmos patentados, de justicia mientras patentan prejuicios, de seguridad mientras exportan infraestructuras de vigilancia a regímenes autoritarios. En este contexto, cualquier marco que no aborde la asimetría fundamental de poder en el desarrollo y despliegue de la IA no sólo es ineficaz, sino cómplice. Por lo tanto, las auditorías y evaluaciones participativas deben ser jurídicamente vinculantes y estar diseñadas no sólo para diversificar los inputs, sino también para redistribuir el control y reconfigurar el poder”.

La organización de la próxima Cumbre en la India, quizás en este mismo año de 2025; el papel que desee jugar Naciones Unidas en el diseño del nuevo marco global de gobernanza de la IA; las decisiones geoestratégicas de la nueva administración estadounidense; los intereses indisimulados de las Big Tech; la resiliencia de la UE con respecto a la defensa de sus propias normas relacionadas con la IA y la capacidad de análisis objetivo, organización y resistencia de la sociedad civil independiente y los ámbitos académicos son algunos de los elementos que van a decidir qué ocurre con la IA en los próximos años. Y no se trata sólo de un asunto geoestratégico, o político o económico: es la propia concepción de la democracia lo que está en cuestión en estos momentos cruciales. En París, patria de Charles Perrault, se ha entrevisto el futuro: tiene el oscuro y feo aspecto de la boca de un lobo.